Women Take On The Digital Divide

Eine mehrteilige Veranstaltungsreihe zur digitalen Transformation

"Women Take on the Digital Divide" – die mehrteilige Veranstaltungsreihe zur digitalen Transformation beinhaltet Diskussionen zu Fragen wie: Wie wird die Digitale Revolution besonders die Arbeit von Frauen beeinflussen? Wie können Konzepte wie Blockchain oder Kryptowährungen von Frauen emanzipatorisch verwendet werden? Auf welche Weise beeinflussen Algorythmen den Zugang zu Dienstleistungen, Jobs oder auch Versicherungen für Frauen schon jetzt?

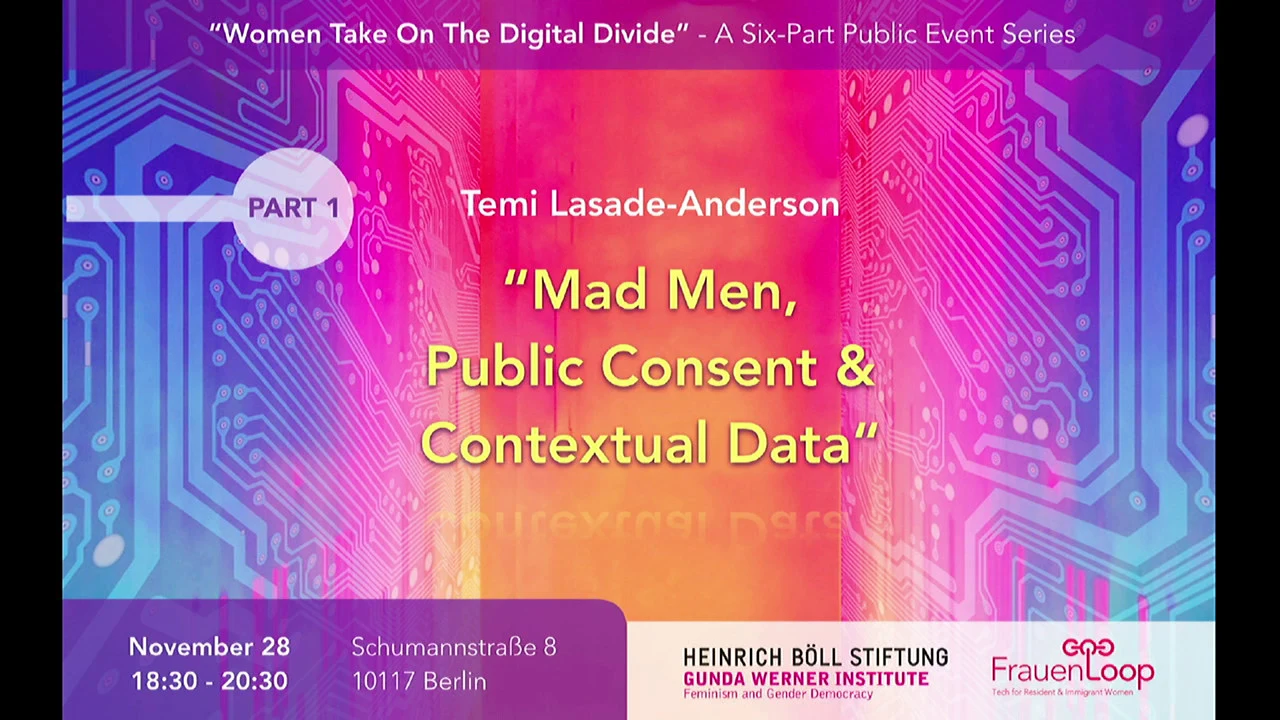

Teil 1: "Mad Men”: Öffentliche Zustimmung und Datenschutz

Die schlechten alten Zeiten chauvinistischer, stereotyper und ausschließender Werbug wurden von der Fernsehserie "Mad Men" festgehalten: Die heutige Werbung ist jedoch eine hochtechnologische, konzentrierte Explosion von "klebrigen" Inhalten, die Sie einbinden und alles über Sie herausfinden sollen. Menschen in der Technologiebranche verwenden Werbeblocker und virtuelle private Netzwerke für den Datenschutz, aber was ist mit dem Rest von uns? Dieser Vortrag stellt die schöne neue Welt vor, in der Anzeigen-Targeting und Retargeting, Treueprogramme und Plattformen wie Instagram und Facebook in einem gesetzlosen "Wilden Westen" funtionieren, in dem es keine Regulierung gibt und Kontextdaten der neue Goldrausch sind.

Temi Lasade-Anderson ist Anwältin für Datenbewusstsein und Datenschutz. Nachdem sie 5 Jahre lang digitale Kampagnen für große E-Commerce- und Technologieunternehmen geplant hat, nutzt sie ihre Marketing- und Kommunikationsfähigkeiten nun für datenschutzorientierte Technologieunternehmen wie Mozilla sowie für gemeinnützige Organisationen, die sich dafür einsetzen, dass marginalisierte Menschen einen besseren Zugang und mehr digitale Rechte bekommen, sowie stärker inkludiert werden.

In Zusammenarbeit mit

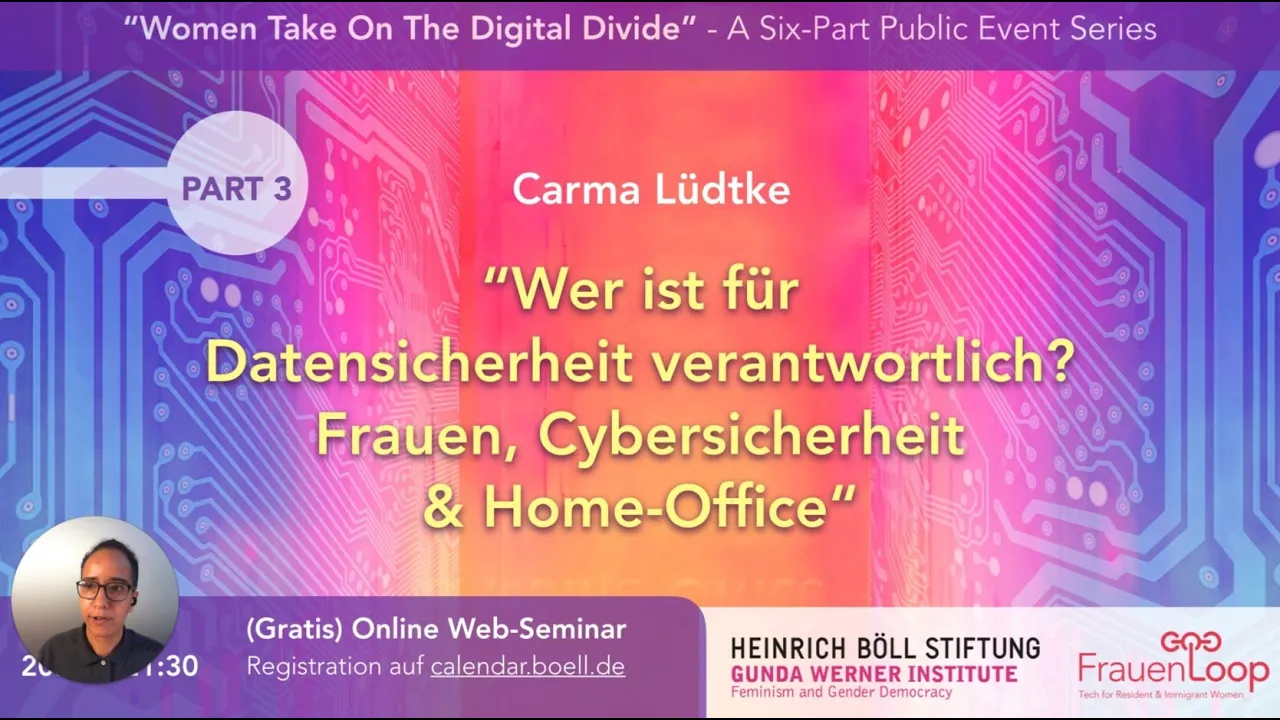

Teil 2: Wer ist für Datensicherheit verantwortlich? Frauen, Cybersicherheit & Home Office

Wer ist für Datensicherheit verantwortlich? Frauen, Cybersicherheit & Home Office - Heinrich-Böll-Stiftung

Direkt auf YouTube ansehen

Direkt auf YouTube ansehen

mit:

Carma Lüdtke, deutsche Cybersicherheitsexpertin, CEO von Lacewing Tech, zuvor bei Bundesamt für Sicherheit in der Informationstechnik (BSI) tätig

Dr. Nakeema Stefflbauer, FrauenLoop

Francesca Schmidt, Gunda-Werner-Institut

Selbstfahrende Autos, Drohnen und Algorithmen sorgen regelmäßig für Schlagzeilen. Doch unsere mittlerweile alltägliche Abhängigkeit von Hard- und Software, vor allem aber von Daten, die in Cloudlösungen abgelegt und damit ortsuneingeschränkt verfügbar gemacht werden, erhöht zunehmend unsere (digitale) Verletzlichkeit. Was digital sicher ist, wird von „Techies“, Politiker*innen und Wirtschaftsexpert*innen definiert. Doch wer wird in solchen Aushandlungsprozessen mitbedacht? Sehr oft sind es Frauen, die für fehlende Sicherheit einen hohen Preis zahlen.

Am 9. Juli widmete sich das Gunda-Werner-Institut in der Heinrich-Böll-Stiftung in Kooperation mit FrauenLoop im dritten (Online-)Vortrag in der Reihe „Women Take on the Digital Divide“ genau dieser Thematik. Wie schränken Home-Office, privates Cloud-Hosting und lax ausgelegte Regeln des Datenschutzes unsere Freiheit online ein? Wie können wir dagegen vorgehen?

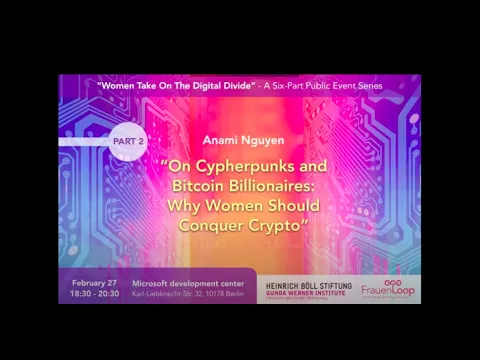

Teil 3: Über Cypherpunks und Bitcoin-Milliardäre: Warum Frauen Krypto erobern sollten

On Cypherpunks and Bitcoin Billionaires: Why Women Should Conquer Crypto - Heinrich-Böll-Stiftung

Direkt auf YouTube ansehen

Direkt auf YouTube ansehen

mit:

Anami Nguyen, NEUFUND

Dr. Nakeema Stefflbauer, FrauenLoop

Francesca Schmidt, Gunda-Werner-Institut

Bitcoin wurde als Gegengift für die Konzentration von Macht und Reichtum an der Wall Street eingeführt. Aber was als Vision einer "Macht für alle" begann, ist zu einer Industrie geworden, die zum großen Teil Diskriminierung einfach fortführt.

Was ist der Unterschied zwischen Elite-Investitionen und einem Währungsmarkt, der erfunden wurde, um demokratische, dezentralisierte Fonds für alle zu fördern? Warum sollen besonders Frauen* die Welt der Kryptowährung verstehen? An ihr teilhaben? Was ist mit dem Versprechen, dass Blockchain die Welt besser macht? Das Gunda-Werner-Institut in der Heinrich-Böll-Stiftung lädt Sie in Kooperation mit FrauenLoop ein, Antworten von einer Finanzspezialistin mit einer einzigartigen Perspektive auf Elite-Investments zu erhalten.

Anami Nguyen hat einen BSc in Finance & Management von der NYU Stern. Sie arbeitete als Analystin für J.P. Morgan. Danach half sie beim Aufbau der Finanzoperationen und Vermögensverwaltung für die Web3 Foundation. Zurzeit ist sie Business Development Managerin bei NEUFUND, einer von Blockchain unterstützten Finanzierungs- und Investitionsplattform.

Teil 4: Computervision: Wer gewinnt und wer verliert?

Computer Vision: Who Benefits and Who Is Harmed? - Heinrich-Böll-Stiftung

Direkt auf YouTube ansehen

Direkt auf YouTube ansehen

Diskussion mit:

Dr. Timnit Gebru, Informatikerin und technische Co-Leiterin des Ethical Artificial Intelligence Team bei Google, Co-Autorin Gender Shades

Dr. Nakeema Stefflbauer, FrauenLoop

Francesca Schmidt, Gunda Werner Institut

Computervision (als Teilbereich der Künstlichen Intelligenz) ist nicht mehr nur ein rein akademisches Unterfangen. Von Strafverfolgung über Grenzkontrolle bis hin zur Diagnostik im Gesundheitswesen werden Computervision-Systeme aktuell in alle Aspekte der Gesellschaft integriert.

Das Projekt Gender Shades hat gezeigt, dass kommerzielle Systeme zur Klassifizierung der Geschlechter große Unterschiede in der Fehlerquote nach Hauttyp und Geschlecht aufweisen. Weitere wissenschaftliche Arbeiten zeigen und diskutieren die Schäden, die durch die bloße Existenz automatischer Systeme zur Erkennung des Geschlechts verursacht werden. Jüngste Arbeiten haben auch schockierende rassistische und sexistische Bezeichnungen in populären Computervision-Datensätzen aufgedeckt - mit dem Ergebnis, dass einige davon entfernt wurden.

Heute gibt es in der Forschung Arbeiten, die vorgeben, die Sexualität einer Person anhand ihrer Profilbilder in sozialen Netzwerke zu bestimmen, und andere, die behaupten, "gewalttätige Personen" anhand von Drohnenaufnahmen zu klassifizieren. Ein kritischer öffentlicher Diskurs über den Einsatz von auf Computervisionen basierenden Technologien nimmt jedoch zu. Der Einsatz von Gesichtserkennungstechnologien durch Polizeibehörden ist in den USA heftig kritisiert worden, und als Reaktion darauf haben Unternehmen wie Microsoft, Amazon und IBM ihre Dienstleistungen im Bereich der Gesichtserkennungssoftware zurückgezogen oder eingestellt.

In ihrem Vortrag stellt Dr. Timnit Gebru einige der Probleme und Lösungsvorschläge, welche die algorithmische Bias (Voreingenommenheit) abschwächen sollen, vor. Sie zeigt, dass einige der vorgeschlagenen Korrekturen das Problem eher verschärfen als abschwächen könnten.